41139021

با ما در تماس باشید

سبد خرید شما خالی است.

با ما در تماس باشید

لایک0

با استفاده از روشهای زیر میتوانید این صفحه را با دوستان خود به اشتراک بگذارید.

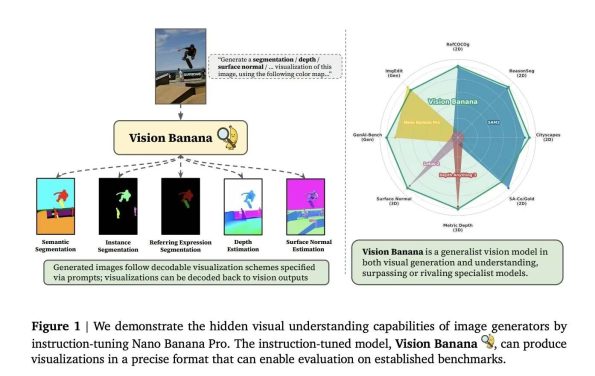

Vision Banana نام مدلی است که توسط پژوهشگران Google DeepMind معرفی شده و ادعای اصلی آن، شکستن یکی از فرضهای قدیمی در بین جامعه بینایی ماشین است؛ این فرض که مدلهایی که برای تولید تصویر ساخته میشوند الزاماً در فهم تصویر قوی نیستند و برای وظایف تحلیلی و ادراکی باید سراغ معماریهای تخصصی رفت.

مقالهای که این مدل را معرفی میکند با عنوان Image Generators are Generalist Vision Learners منتشر شده و استدلال آن روشن است: همانطور که در مدلهای زبانی، پیشتمرین مولد باعث شکلگیری نمایشهای عمیق و قابلانتقال از زبان میشود، در بینایی ماشین هم پیشتمرین برای تولید تصویر میتواند به شکل طبیعی فهمی غنی از هندسه، معنا، عمق و روابط بین اشیا ایجاد کند.

Vision Banana دقیقاً بر همین پایه ساخته شده و نشان میدهد که یک مدل مولد تصویر، اگر بهدرستی instruction-tune شود، میتواند همزمان هم تصویر بسازد و هم آن را در سطحی بسیار رقابتی بفهمد.

اهمیت Vision Banana فقط در یک عدد benchmark یا یک دمو خلاصه نمیشود. نکته اصلی این است که Google DeepMind در این کار، مرز سنتی بین مدلهای generative و discriminative را بهصورت عملی زیر سؤال برده است. در رویکرد کلاسیک، مدلهای segmentation، depth estimation یا surface normal estimation معمولاً با headهای اختصاصی، طراحی task-specific و دادههای برچسبخورده تخصصی آموزش داده میشوند.

اما Vision Banana بدون تکیه به چنین معماریهای مجزایی، وظایف مختلف ادراکی را صرفاً از طریق تولید خروجیهای RGB قابل decode انجام میدهد. این تغییر، از نظر مفهومی بسیار مهم است؛ چون اگر این پارادایم تثبیت شود، تصویرسازی دیگر فقط یک endpoint برای تولید محتوای بصری نیست، بلکه به یک رابط عمومی برای حل مسائل اصلی بینایی ماشین تبدیل میشود.

پایه اصلی Vision Banana مدلی به نام Nano Banana Pro یا بهاختصار NBP است که بهعنوان مدل مولد تصویر پیشرفته Google معرفی شده است. تیم Google DeepMind بهجای ساختن یک معماری جدید از صفر، از همان مدل پایه استفاده کرده و تنها یک مرحله instruction-tuning سبک روی آن انجام داده است.

در این مرحله، نسبت کمی از دادههای مرتبط با وظایف بینایی ماشین به مخلوط آموزشی اصلی مدل اضافه شده تا مدل یاد بگیرد دانش بصری نهفتهای را که در جریان تولید تصویر کسب کرده، در قالب خروجیهای قابلاندازهگیری و ارزیابی بیان کند.

نقطه کلیدی اینجاست که Google ادعا میکند این instruction-tuning سبک، نقش مشابه alignment در مدلهای زبانی را دارد؛ یعنی بهجای اینکه دانش جدیدی از صفر ساخته شود، دانشی که از قبل در مدل وجود داشته به شکلی کاربردی و task-aware قابل استفاده میشود.

در Vision Banana نکته مهم دیگر این است که هیچ دادهای از benchmarkهایی که برای ارزیابی استفاده شدهاند در مخلوط instruction-tuning وارد نشده است. این موضوع برای اعتبار نتایج اهمیت مستقیم دارد، چون باعث میشود عملکرد مدل را به memorization یا نشت داده نسبت ندهیم.

وقتی Vision Banana روی دیتاستهایی مثل Cityscapes، RefCOCOg، ReasonSeg، KITTI یا NYU نتیجه میگیرد، ادعا این است که مدل از قبل آن دادهها را در فرایند instruction-tuning ندیده و بنابراین نتایج باید به توانایی generalization واقعی نسبت داده شوند، نه تطبیق دروندامنهای. این بخش از طراحی مقاله، برای هر کسی که به صحت benchmarkها حساس است، یکی از مهمترین نقاط قوت کار محسوب میشود.

تفاوت اصلی Vision Banana با بسیاری از مدلهای رایج بینایی ماشین در این است که خروجی تمام وظایف را بهجای فرمتهای اختصاصی، در قالب تصویر RGB بازنمایی میکند. این یعنی مدل برای semantic segmentation، instance segmentation، metric depth estimation و surface normal estimation از headهای جداگانه یا decoderهای مخصوص استفاده نمیکند. بهجای آن، خروجی هر task بهصورت یک تصویر ساخته میشود که در آن رنگها معنای دقیق و قابلبازگشایی دارند. این طراحی باعث میشود کل سیستم با یک مجموعه وزن یکپارچه کار کند و تنها چیزی که بین وظایف تغییر میکند، prompt باشد.

این تغییر به ظاهر ساده، پیامدهای عمیقی دارد. در معماریهای سنتی، هر وظیفه معمولاً مسیر خروجی، loss، برچسبگذاری و post-processing مخصوص خود را دارد.

اما در Vision Banana فرض این است که اگر مدل واقعاً از تصویر «میفهمد»، باید بتواند این فهم را در قالب یک تصویر جدید که semantics یا geometry را encode کرده نشان دهد. به همین دلیل، خروجی segmentation فقط یک ماسک دودویی ساده نیست، بلکه یک visualization رنگی است که با یک نگاشت مشخص به کلاسها مرتبط میشود.

خروجی depth هم نقشهای رنگی است که از طریق transform معکوسپذیر دوباره به فاصلههای واقعی برمیگردد. این رویکرد باعث میشود image generation از یک ابزار صرفاً خلاقانه، به یک زبان مشترک برای بیان ادراک بصری تبدیل شود. این همان ایدهای است که Vision Banana را از یک مدل بهینهشده معمولی جدا میکند.

در semantic segmentation، Vision Banana با یک دستور متنی مشخص هدایت میشود تا برای تصویر ورودی، یک visualization تولید کند که در آن هر کلاس با رنگی که در prompt تعریف شده نمایش داده شود. این طراحی بسیار مهم است، چون مدل را به یک واژگان ثابت از کلاسها محدود نمیکند..

در معماریهای سنتی، segmentation معمولاً به کلاسهایی وابسته است که از ابتدا در head نهایی تعریف شدهاند، اما در Vision Banana رنگ هر کلاس در متن prompt تعیین میشود. بنابراین اگر گفته شود cat قرمز باشد و background زرد، مدل بر اساس همان نگاشت خروجی میسازد و ارزیابی بعدی از روی decode همین رنگها انجام میشود.

این انعطافپذیری در عمل به Vision Banana اجازه میدهد semantic segmentation را بدون نیاز به ساختار label-space ثابت انجام دهد. از نظر مفهومی، این نکته نشان میدهد که مدل بهجای تکیه به دستهبندی بسته، از یک representation عمومیتر از تصویر استفاده میکند.

نتیجه benchmark هم برای این بخش قابلتوجه است: Vision Banana روی Cityscapes val به mIoU برابر 0.699 رسیده، در حالی که SAM 3 عدد 0.652 را ثبت کرده است. این اختلاف 4.7 پوینت در چنین benchmarkی کوچک نیست و نشان میدهد که رویکرد تولیدمحور Vision Banana فقط یک ایده نظری جذاب نیست، بلکه در یکی از وظایف کلاسیک بینایی ماشین بهصورت عملی از یک مدل شناختهشده تخصصی جلو زده است.

در instance segmentation مسئله پیچیدهتر است، چون برخلاف semantic segmentation، تعداد instanceها از قبل مشخص نیست. Vision Banana برای حل این مسئله از یک راهبرد per-class inference استفاده میکند. یعنی مدل برای هر کلاس بهصورت جداگانه اجرا میشود و سپس برای هر instance رنگی منحصربهفرد اختصاص پیدا میکند.

در مرحله بازیابی ماسکها، پیکسلهایی که رنگهای مشابه دارند با استفاده از threshold خوشهبندی میشوند تا instanceهای مستقل استخراج شوند. این روش نشان میدهد که Vision Banana بهجای relying بر decoderهای کلاسیک instance masks، از خود سازوکار تصویرسازی برای ساختن مرزهای نمونهها استفاده میکند.

نکته مهم اینجاست که این روش با وجود سادگی مفهومی، در benchmarkها رقابتی عمل کرده است. در ارزیابی SA-Co/Gold، مدل به pmF1 برابر 0.540 رسیده که نزدیک به DINO-X با 0.552 است و از Gemini 2.5 با 0.461، APE-D با 0.369 و OWLv2 با 0.420 جلوتر قرار میگیرد.

این نتایج در تنظیم zero-shot transfer گزارش شدهاند؛ یعنی Vision Banana برای این دادهها بهطور مستقیم آموزش ندیده است. همین نکته باعث میشود عملکرد آن در instance segmentation فقط یک موفقیت مهندسی جزئی نباشد، بلکه نشانهای از generalization واقعی مدل در سطح instance-level perception باشد.

یکی از بخشهای مهم نتایج Vision Banana مربوط به وظایفی است که تنها به تفکیک پیکسلها محدود نمیشوند و عنصر زبانی یا استدلالی هم در آنها نقش دارد. در referring expression segmentation، مدل باید بر اساس یک عبارت ارجاعی مشخص کند کدام بخش از تصویر مدنظر است.

در benchmark RefCOCOg UMD val، Vision Banana به cIoU برابر 0.738 رسیده و از SAM 3 Agent با 0.734 کمی جلوتر قرار گرفته است. شاید اختلاف عددی کوچک بهنظر برسد، اما در چنین benchmarkهایی همین اختلافها هم معنادارند، بهخصوص وقتی بدانیم مدل از معماری تخصصی segmentation استفاده نمیکند و کل فرایند را در قالب image generation انجام میدهد.

در reasoning segmentation، اهمیت کار حتی بیشتر میشود، چون مدل باید فراتر از تشخیص ساده اشیا برود و نوعی استدلال یا فهم سطح بالاتر را در segmentation منعکس کند. در ReasonSeg val، Vision Banana عدد gIoU برابر 0.793 را ثبت کرده، در حالی که SAM 3 Agent به 0.770 رسیده است.

مقاله حتی اشاره میکند که این نتیجه از برخی روشهای non-zero-shot که روی دادههای دروندامنه آموزش دیدهاند نیز بهتر است، از جمله X-SAM. این نکته برای Vision Banana بسیار مهم است، چون نشان میدهد مدل فقط در وظایف low-level vision یا segmentation معمولی قوی نیست، بلکه در سناریوهایی که فهم معنایی و ارجاعی بیشتری لازم است نیز میتواند رقابت کند.

یکی از فنیترین و در عین حال مهمترین بخشهای مقاله Vision Banana مربوط به metric depth estimation است. در اینجا مسئله فقط پیشبینی relative depth یا ترتیب نزدیکی و دوری اشیا نیست؛ مدل باید فاصلههای واقعی و متریک را بازسازی کند.

برای این هدف، Vision Banana از یک نگاشت یکبهیک و معکوسپذیر بین مقادیر depth در بازه [0, ∞) و مقادیر محدود RGB در بازه [0, 1]³ استفاده میکند. ابتدا یک power transform با پارامترهای λ = −3 و c = 10/3 روی مقادیر depth اعمال میشود تا توزیع فاصلهها خم شود و برای نگاشت رنگی مناسبتر گردد. سپس این مقادیر به یک visualization رنگی کاذب encode میشوند که در امتداد لبههای مکعب RGB و بر اساس ساختار یک منحنی هیلبرت سهبعدی حرکت میکند.

اهمیت این طراحی در معکوسپذیر بودن کامل آن است. یعنی تصویری که مدل میسازد فقط یک نمایش تقریبی از عمق نیست، بلکه میتوان آن را دقیقاً decode کرد و به فاصلههای فیزیکی متریک برگشت. این رویکرد یک تفاوت جدی با بسیاری از pipelineهای depth estimation دارد که در آنها خروجی بیشتر شبیه regression map است.

نکتهای که Vision Banana را جالبتر میکند این است که برای تخمین عمق، نه در آموزش و نه در inference به پارامترهای دوربین نیاز ندارد؛ نه intrinsics و نه extrinsics. مدل باید صرفاً از سرنخهای بصری و دانشی که در پیشتمرین روی تصویر بهدست آورده، مقیاس مطلق را استنباط کند.

علاوه بر این، دادههای آموزشی depth در این کار کاملاً synthetic هستند و از engineهای رندر شبیهسازی تولید شدهاند؛ یعنی هیچ داده depth واقعی برای آموزش استفاده نشده است.

با این حال، Vision Banana در چهار دیتاستی که با Depth Anything V3 مقایسه شده، امتیاز δ1 برابر 0.929 را ثبت کرده، در حالی که Depth Anything V3 به 0.918 رسیده است. میانگین δ1 روی شش benchmark اصلی هم 0.882 گزارش شده است. این نتایج برای مدلی که نه از داده واقعی depth استفاده کرده و نه پارامتر دوربین را میخواهد، بسیار قابلتوجه هستند.

در surface normal estimation، هدف پیشبینی جهتگیری نرمال سطوح در هر پیکسل است. در Vision Banana این وظیفه نسبت به depth نگاشت مستقیمتری دارد، چون خود نرمالها بردارهای واحد سهبعدی با مؤلفههای x، y، z در بازه −1.0 تا 1.0 هستند و میتوانند بهصورت طبیعی به کانالهای RGB نگاشت شوند.

بهاینترتیب، جهتهای مختلف سطح در قالب رنگهای مختلف رمزگذاری میشوند؛ مثلاً نرمالهای رو به چپ به طیفی متمایل به قرمز-صورتی، نرمالهای رو به بالا به سبز روشن و نرمالهای متمایل به دوربین به آبی یا بنفش روشن encode میشوند.

مزیت این روش در Vision Banana این است که باز هم نیاز به head اختصاصی جداگانه حذف میشود و مدل تنها با تولید یک تصویر RGB، اطلاعات هندسی صحنه را منتقل میکند.

از نظر benchmark، Vision Banana در چهار دیتاست ارزیابیشده به average mean angle error برابر 18.928° رسیده، در حالی که Lotus-2 عدد 19.642° را ثبت کرده است.

روی دیتاستهای indoor نیز مدل پایینترین mean angle error برابر 15.549° و پایینترین median angle error برابر 9.300° را در بین روشهای مقایسهشده بهدست آورده است. این بخش از نتایج نشان میدهد که Vision Banana فقط در وظایف semantic یا referential قوی نیست، بلکه در فهم هندسه سطح هم به سطحی رسیده که با مدلهای تخصصی رقابت میکند.

علت اینکه Vision Banana توجه زیادی جلب کرده فقط این نیست که در چند benchmark امتیاز خوبی گرفته است. ارزش واقعی آن در تغییری است که در نگاه به foundation models بینایی پیشنهاد میکند.

سالها این تصور غالب وجود داشت که برای درک تصویر باید سراغ مدلهایی رفت که مستقیماً برای همین کار طراحی شدهاند؛ در مقابل، مدلهای مولد صرفاً برای تولید خروجیهای بصری و کاربردهای خلاقانه مناسب بودند. Vision Banana این دوگانه را تضعیف میکند و نشان میدهد خود فرایند یادگیری برای تولید تصویر، ممکن است بهصورت طبیعی representationهایی را شکل دهد که برای perception هم بسیار قدرتمند باشند.

این ایده از جهاتی معادل همان چیزی است که در LLMها رخ داد. در مدلهای زبانی، pretraining مولد روی متن خام باعث شد نمایشهایی بهوجود بیاید که در ترجمه، خلاصهسازی، پرسشپاسخ، استدلال و بسیاری وظایف دیگر قابلاستفاده باشند.

Vision Banana میگوید در بینایی هم ممکن است image generation همان نقش foundational را بازی کند. اگر این فرض در پژوهشهای بعدی هم تأیید شود، مسیر طراحی مدلهای vision بهشدت تغییر خواهد کرد.

بهجای ساختن سیستمهای مجزا برای segmentation، depth، normals، detection و understanding، ممکن است یک مدل مولد تصویر instruction-tuned بهتنهایی برای همه این وظایف کافی باشد. این دقیقاً همان دلیل اصلی است که Vision Banana را از یک مقاله صرفاً موفق به یک مقاله پارادایمی تبدیل میکند.

یکی از پرسشهای طبیعی درباره Vision Banana این است که آیا instruction-tuning برای وظایف ادراکی باعث افت توانایی اصلی آن در image generation شده یا نه.

نتایج ارائهشده در مقاله نشان میدهند که پاسخ منفی است. در benchmarkهای مولد، Vision Banana در GenAI-Bench برای text-to-image به win rate برابر 53.5% در برابر Nano Banana Pro رسیده و در benchmark ImgEdit برای image editing نیز 47.8% ثبت کرده، در حالی که مدل پایه 52.2% بهدست آورده است. این اعداد نشان میدهند که instruction-tuning سبک انجامشده، کیفیت مولد مدل را بهصورت معنادار تخریب نکرده است.

این مسئله از نظر مهندسی و محصولی بسیار مهم است. در بسیاری از موارد، وقتی یک مدل را برای وظایف جدید fine-tune میکنیم، خطر فراموشی یا کاهش عملکرد در capability اولیه وجود دارد.

اما Vision Banana نشان میدهد که اگر وظایف جدید همچنان در قالب خروجیهای RGB و سازگار با ماهیت مولد مدل فرموله شوند، میتوان بین generation و understanding همزیستی مؤثری ایجاد کرد. به بیان دقیقتر، Vision Banana صرفاً مدلی نیست که از image generation به سمت perception رفته باشد؛ بلکه مدلی است که هر دو را همزمان حفظ کرده و این موضوع یکی از نقاط قوت اصلی آن است.

وقتی به طراحی Vision Banana نگاه میکنیم، چند مزیت عملی و مفهومی کاملاً روشن میشود. نخست اینکه مدل با یک مجموعه وزن واحد، چندین وظیفه متفاوت را پوشش میدهد و برای جابهجایی بین taskها نیازی به تغییر معماری، head یا branch مجزا ندارد. این یعنی سادگی بیشتر در نگهداری، آموزش، استقرار و استفاده.

دوم اینکه instruction-tuning موردنیاز نسبتاً سبک است، چون مدل در اصل دانش بصری را از قبل در pretraining مولد کسب کرده و فقط باید یاد بگیرد آن را در فرمت مناسب خروجی بیان کند. سوم اینکه چون خروجی تمام وظایف همچنان تصویر RGB است، سازگاری با ماهیت مولد مدل حفظ میشود و احتمال افت توانایی generative کمتر میشود.

در کنار این مزایا، Vision Banana از نظر انعطافپذیری هم جالب است. برای semantic segmentation نیازی به vocabulary ثابت ندارد، برای depth estimation به پارامتر دوربین وابسته نیست، و برای surface normals میتواند هندسه را مستقیماً در فضاهای رنگی encode کند.

این ویژگیها در مجموع نشان میدهند که مدل فقط یک پیادهسازی clever نیست، بلکه یک روش کلی برای بازتعریف خروجیهای perception بهعنوان image generation است. اگر این خط پژوهشی ادامه پیدا کند، مزیت Vision Banana ممکن است بهمراتب فراتر از benchmarkهای فعلی برود و به طراحی نسل بعدی مدلهای vision بینجامد.

با وجود نتایج قوی، درباره Vision Banana باید با دقت حرف زد و از اغراق فاصله گرفت. اینکه این مدل در چند benchmark از سامانههای تخصصی جلو افتاده، بهمعنای حل کامل مسئله بینایی ماشین نیست.

بسیاری از benchmarkها تنظیمات خاص خود را دارند و در عمل، performance در سناریوهای production ممکن است تحت تأثیر latency، هزینه inference، وضوح ورودی، robustness در domain shift و کیفیت decode خروجی RGB قرار بگیرد.

همچنین instance segmentation در این مدل با راهبرد per-class inference انجام میشود که از نظر محاسباتی میتواند در بعضی سناریوها پرهزینهتر از معماریهای انتهابهانتها باشد.

همچنین لازم است توجه شود که برتری Vision Banana نسبت به مدلهایی مثل SAM 3 یا Depth Anything V3 در همان وظایف و benchmarkهایی معنا دارد که در مقاله گزارش شدهاند. بدون ارزیابی مستقل روی مجموعهدادهها و شرایط عملیاتی دیگر، نمیتوان حکم کلی صادر کرد که Vision Banana در هر کاربردی بهترین انتخاب است.

نکته دقیق این است که این مدل بر اساس دادههای منتشرشده، در چند وظیفه کلیدی بینایی و در شرایط zero-shot transfer عملکردی بسیار قوی و در مواردی بهتر از روشهای تخصصی نشان داده است. همین گزاره، هم دقیق است و هم برای نشان دادن اهمیت مقاله کافی است.

Vision Banana یکی از مهمترین مدلهایی است که در ماههای اخیر در مرز بین image generation و visual understanding معرفی شده است.

Google DeepMind با این مدل نشان داده که یک image generator instruction-tuned میتواند بدون معماری تخصصی جداگانه، در semantic segmentation، instance segmentation، referring expression segmentation، reasoning segmentation، metric depth estimation و surface normal estimation به نتایجی برسد که با مدلهای تخصصی روز رقابت میکنند و در چند مورد از آنها عبور میکنند.

مهمتر از همه، این مدل این کار را بدون از دست دادن توانایی اصلی خود در تولید تصویر انجام میدهد.

اگر ادعای مرکزی Vision Banana در کارهای بعدی هم تکرار و تثبیت شود، تصویرسازی میتواند به رابط عمومی بینایی ماشین تبدیل شود؛ همانطور که generation در مدلهای زبانی به زیرساخت وظایف مختلف NLP تبدیل شد.

به همین دلیل، Vision Banana فقط یک مدل جدید نیست؛ بلکه نشانهای جدی از تغییری عمیق در جهتگیری پژوهش بینایی ماشین است. برای پژوهشگران، مهندسان ML و فعالان حوزه foundation models، Vision Banana مدلی است که باید با دقت دنبال شود.

Vision Banana مدل معرفیشده توسط Google DeepMind است که با instruction-tuning روی Nano Banana Pro ساخته شده و وظایف مختلف بینایی ماشین را در قالب image generation انجام میدهد.

Vision Banana در semantic segmentation، instance segmentation، referring expression segmentation، reasoning segmentation، metric depth estimation و surface normal estimation ارزیابی شده است.

بر اساس نتایج منتشرشده، Vision Banana در semantic segmentation روی Cityscapes، در referring expression segmentation روی RefCOCOg و در reasoning segmentation روی ReasonSeg از SAM 3 یا SAM 3 Agent عملکرد بهتری نشان داده است.

Vision Banana عمق متریک را با یک نگاشت معکوسپذیر بین مقادیر depth و تصویر RGB encode میکند و سپس خروجی را دوباره به فاصلههای واقعی decode میکند.

طبق اطلاعات مقاله، Vision Banana برای metric depth estimation به intrinsics و extrinsics دوربین نیاز ندارد.

بله. نتایج benchmarkهای مولد نشان میدهند که instruction-tuning سبک، توانایی image generation مدل پایه را بهطور معنادار از بین نبرده است.